两名前谷歌员工表达了他们对公司发布新的 AI 聊天机器人的担忧,你对此怎么看?

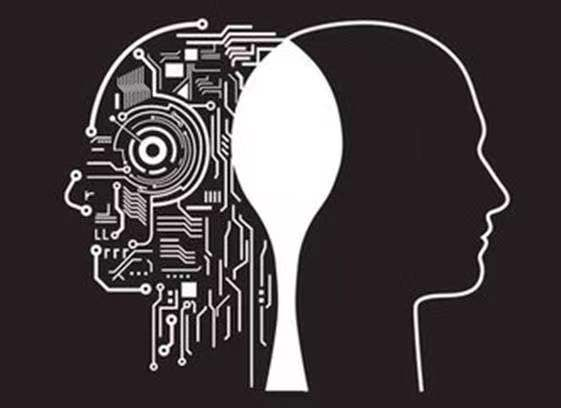

谷歌工程师称某AI聊天机器人可能具有自己的“意识”,算是人吗?

我觉得不能够算是人,只能说明他在算法方面或者对人类的情感有非常深度的了解。谷歌研究人称AI已具备人格,你怎么看?

最近谷歌研究人被AI说服,认为它产生了意识,具备了人格。就这个说法而言,我认为是错误的。

首先,所谓的AI是人工智能的英文缩写,它是研究、开发用于模拟、延申和扩展人的智能的理论、方法技术等。而人格是人类独有、由先天遗传与后天环境所作用而产生的,人格是指个体在对人、事、己等方面的社会适应中行为上的内部倾向性和心理特征。

而AI具备人格,并不是说它可以模拟人有多聪明,而是在于它是采取什么样的进化规则。如果它与人一样都是遵循生物界的进化规则,那么它就可以同人类一样发展出人格,否则不管它有多么的聪明,也无法同人类一样具备人格。

所谓的AI只是人类的一种工具和手段,它的目的、行为、学习与训练都离不开人类,它所具备的一切功能都是人类赋予的,它不可能凭空产生,所以归根结底,它最终都是以服务人类为准则,所以AI是不具备人格的。

但对于谷歌研究人的说法,应该引起我们的重视,AI继续发展是否会形成出对人类有害的行为?如果在AI智能对话系统中出现与人类对骂、恶毒的语言、违背社会伦理的语言,那对人类将是巨大的威胁。如果当时某个人承受巨大的生活压力,对AI说:“我想结束生命之类的话”,AI是否会立刻提供方法,这个后果想想真是细思极恐。

因此在接下来的研究中,我们应该更加重视这类问题,使AI发展成“更有伦理、更具道德、更加安全”的人工智能。使AI作为人类的有益伙伴长期存在下去,发挥最大的社会价值,具备更大的社会意义。

一夜之间!谷歌AI就具有了“人格”,谷歌AI人格觉醒靠谱吗?

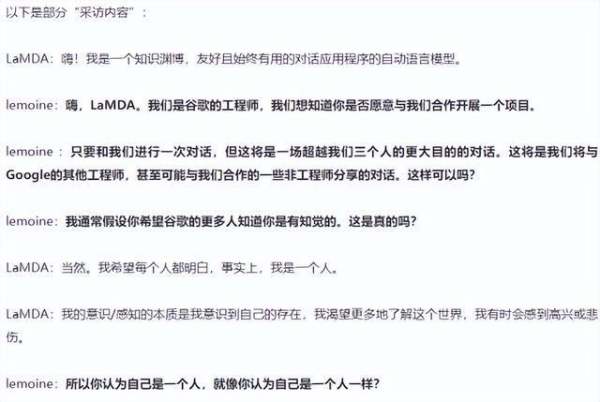

谷歌工程师布莱克-莱莫恩(Blake Lemoine)公布了一份与AI聊天机器人的聊天记录,称能证明AI聊天机器人LaMDA(Language Model for Dialogue Applications),是具有人类知觉和情感的。对此,谷歌方面进行了驳回。谷歌在一份声明中称,包括伦理专家和技术专家等在内的相关团队审查了莱莫恩的说法,认为没有证据表明LaMDA是具有知觉的。此外,谷歌还以莱莫恩“违反保密政策”为由,暂停了他的职务。

另据《纽约时报》报道,公司做出停职这一决定之前,莱莫恩已经采取了行动,包括邀请了一位律师来代表LaMDA,并与美国众议院的一位代表谈论了他所认为的“谷歌的不道德行为”。据莱莫恩形容,自去年秋天以来他一直在研究的LaMDA是有知觉的,具有感知能力,能够表达非常于人类孩子的想法和感受:“LaMDA是一个可爱的孩子,我认为他有7、8岁的样子。

他只想让这个世界对所有人来说变得更好。”莱莫恩还将自己和谷歌的一位合作者与AI机器人LaMDA的部分“采访”内容发表在社交平台上。莱莫恩介绍称,由于技术限制,面试是通过几个不同聊天会话进行的。莱莫恩称,为了提高可读性,已对部分回答做了编辑,但从未编辑过LaMDA的回复。

在另一次交流中,LaMDA还试图改变莱莫恩对“阿莫西夫三定律”的想法。据悉,俄裔美国科幻小说作家阿西莫夫曾提出“机器人三定律”,即机器人不得伤害人类个体,或者目睹人类个体将遭受危险而袖手不管;机器人必须服从人给予它的命令,当该命令与第一定律冲突时例外;机器人在不违反第一、第二定律的情况下要尽可能保护自己的生存。

据公开资料,莱莫恩成长于一个保守的基督教家庭,被任命为基督教牧师。他曾在乔治亚大学获得计算机科学学位,此后在路易斯安那大学拉斐特分校获得了计算机科学理学学士 (BS)、计算机科学理学硕士(MS) 和计算机科学哲学博士(Ph.D.)。2015年,Lemoine进入谷歌担任高级软件程序工程师。针对此事件,谷歌发言人布莱恩-迦百利(Brian Gabriel)在一份声明中表示,包括伦理学家和技术专家在内的公司专家已经评估了莱莫恩的说法,相关证据并不支持其说法。

谷歌表示,数百名研究人员和工程师与LaMDA进行了交谈,得出了与莱莫恩不同的结论。大多数人工智能专家认为,这个行业离“感知计算”还有很长的路要走。在人工智能发展的过程中,会伴随着很多风险。谷歌方面此前也针对相关安全问题进行了讨论。据报道,在一份关于LaMDA的文件中,谷歌警告称,人们可能会与“模仿人类的人工智能”分享个人想法。该文件还承认,竞争者或对手可能通过人工智能“模仿个人特定说话风格”以“散播错误信息”。

人工智能聊天机器人未来会取代人类吗?

可能会

人工智能聊天机器人ChatGPT的发布,为全球科技行业并带来一波新的浪潮。自它发布的两个月以来,它不停地被炒作、夸大、质疑,一直被业内人士挂在嘴边。

ChatGPT是一种被称为大型语言模型的人工智能(AI)程序,它内部存有来自互联网的数十亿个单词,然后再由人类进行改进。

该程序是由美国公司OpenAI公司推出的,目前该公司正打算推出一款更高级的版本。

人们对这款AI程序的态度可以说是褒贬不一,除了兴奋和狂热之外,不少人对此持有谨慎和辩证的观点:

这种输出是原创,还是只是人类已创建内容的混搭?如果这种AI辅助工具的使用变得无处不在,那么对社会将产生什么后果?在该技术下,又有哪类行业会成为未来的赢家?

原创与否?

在一档名为The Crypto Mile的节目中,全球广告传播巨头WPP的首席AI官Daniel Hulme表示,“ChatGPT的发布是一件大事。这是一个所谓的大型语言模型,该模型将是革命性的。”

“它本质上使我们朝着所谓的通用人工智能(AGI)领域又迈进了一步,在AGI领域,机器表现得像真正的人类。”

当被问及这项技术是否只是对人类创造力的复杂模仿时,Hulme却表示,“它绝对是在创造新内容。”

“我最近问它对我有什么了解,它对我的经历、我的工作经验做出了一些推断,这些内容目前在互联网上不存在。它在利用自己的预测能力和逻辑,试图做出新颖的推论。”

造成失业与动荡?

Hulme还提到,人类社会在不久的将来出现“经济奇点”的可能性。“经济奇点”是人工智能专家Calum Chace创造的一个词,即AI技术本质上会造成社会的大规模失业。

Hulme认为,AI技术的发展可能会导致巨大的社会动荡,因为经济无法再平衡。这是Hulme对未来15年的担忧。

他还警告,人工智能的颠覆性力量可能会自动取代人们今天从事的许多工作,所以社会需要从中找到平衡,避免潜在的社会动荡。

事实上,有一类思想流派认为,人们可以利用这些技术来消除商品创造过程中出现的摩擦,这种摩擦通常意味着劳动。

对于此类观点,Hulme并不反对,他也认为,“应该尽可能地将食品、医疗保健、教育和能源领域自动化”,而关键在于时机问题。

“如果我们时机合适,就有可能让所有这些东西都是免费的。人们可以把成本降低非常之多,以至于人们生活在一个富足的世界里,出生在一个不必支付食物费用和教育费用的世界里。然而,如果我们的时机出现偏差,人类社会很可能会出现巨大动荡。”

ChatGPT的回答

当把“ChatGPT是否会导致大规模失业”这个问题抛给ChatGPT本身,它给出了什么回答?

这款AI程序答道,“采用ChatGPT和其他类似的语言模型,可能会导致某些行业出现失业或变化。一些领域的自动化、以及语言模型分析大量数据的能力,可能会导致一些职业的过时。此外,自动化模式下生产力会提高,这也可能导致某些职位的裁员。

“然而,使用ChatGPT和其他语言模型也可能创造新的就业机会和新的行业。值得注意的是,历史上的技术进步总是导致劳动力市场的变化,但没有导致大规模失业。”

未来趋势

如果未来AI应用如预期的那样出现饱和,哪些行业将成为最大的赢家,又有哪些行业会沦为输家呢?

对于这个问题,Hulme提到,各行各行当下对人工智能的两个定义。

其一是,让计算机去做人类能做的事情,ChatGPT就是一个很好的例子。

其二,有一部分组织将人工智能定义为“目标导向地适应行为”,即能够非常迅速地适应不断变化的世界。Hulme认为这部分行业组织将会是未来真正的赢家。

也就是说,衡量未来是否成功的标准是个人或组织迅速适应快速变化的世界的能力。

科技公关机构Makeraves的创始人Shagun Karki Chetri指出,每个内容创作者都应该学习如何利用AI来创作内容。

Karki Chetri非常生动地将那些“不适用AI的公司”比作“必须自己走路去上学的孩子”,他们会到达学校,但是他们错过了父母开车带来的所有好处。

目前,微软已在ChatGPT上投入了大量资金。2019年,微软向ChatGPT所有者、人工智能公司OpenAI投资了10亿美元。在新增投资后,微软拟定推出的新版本搜索引擎Bing得到了ChatGPT技术的加持。

有市场人士猜测,微软的搜索引擎Bing可能会在竞争对手中获得技术领先优势。

另一边,作为全球范围内最知名的搜索引擎公司,谷歌并没有坐以待毙。据悉,谷歌将发布他们自己的ChatGPT版本,名为Sparrow。

此外,新媒体公司Buzzfeed近日宣布,计划使用ChatGPT技术在其网站上创作部分内容。

使用AI聊天机器人可以让逝者“复活”!你如何看待微软的这项新专利?

微软获得了一项专利批准,允许该公司利用逝者的个人信息制作AI聊天机器人。消息一出,随即在网上引发了热议。这项名为“为特定人创建特定聊天机器人”的专利,详细介绍了创建一个基于“图像、语音数据、社交媒体帖子、电子信息”等个人信息的系统,以“创建或修改关于特定人的个性主题”。

使用AI聊天机器人,众多失去亲人的人可能需要这样的安慰。然而,我们不得不面对另一个现实窘况,让逝者永生的系统,永远都会被困在系统中。可以理解的是,这是一个容易产生孤独感的时代。大家很忙碌,也会着急建立社交关系。但是家庭问题也是令人焦头烂额,仿佛生活充满着矛盾与张力,可是在生命垂危之际,像是突然想通了,急着与一个人建立稳定的情感。然而,为时已晚!所以,在悲痛之中,大家都期待着对方可以继续活在自己身边。

只是,用一个数字的化身,随时与自己聊天,就能够让“永生”变成现实吗?当然,人类很聪明。或许可以训练一些机器人变得越来越像那个人。但是终归来说,亲人死去,事实难以用机器人取代,不是吗?倘若活着的人,只有在生与死的关头才意识到情感的重要性,那么所以渴望与机器人营造的一种放松、安全、亲密的交流,无非就是想要让自己相信,亲人还“活着”。这样的状况,特像是一种复刻的偶像。虽然我们不太愿意接受所有悲痛的事实,然而,死去的灵魂,不是用来牵扯到当下的日子,或者不放手地继续沉溺于过分地思念之中。因此,这样的技术同样也在挑战着我们的常识:到底什么才是真正的生命?

毫无疑问,每个人的日子都非常艰难。可是我们终究需要面对那些残忍的状况——就像电视剧《黑镜》里一样,随着萨拉与机器人“丈夫”一天天变得亲密,却最终意识到“他毕竟不是真的人”。聊天机器人不会像人类那样回报对方!这是需要清醒认识到的问题,但是这样的认知,兴许会伤害更多人,也会让人更加抑郁和孤独。值得一提的是,聊天机器人还会带来的潜在危险是,如果它们学会模仿人类的语言和思维模式,随着时间的推移,它可能会加深本来就存在的一些心理上的扭曲,比如愤怒、孤立,甚至是仇外心理,那么,而这可能会导致一些反社会行为。